Multiplexación de Conexiones: Gestión de Flujos HTTP/2 para TTFB

La multiplexación de conexiones ha revolucionado la forma en que los protocolos web modernos manejan la transmisión de datos, particularmente con la llegada de HTTP/2. Esta tecnología permite que múltiples flujos de datos compartan una única conexión, mejorando significativamente el rendimiento web y la experiencia del usuario. Profundizar en la mecánica de la gestión de flujos en HTTP/2 revela cómo la multiplexación optimiza la velocidad de carga de páginas y reduce la latencia, estableciendo nuevos estándares para una comunicación web eficiente.

Comprendiendo la multiplexación de conexiones y su papel en el rendimiento de HTTP/2

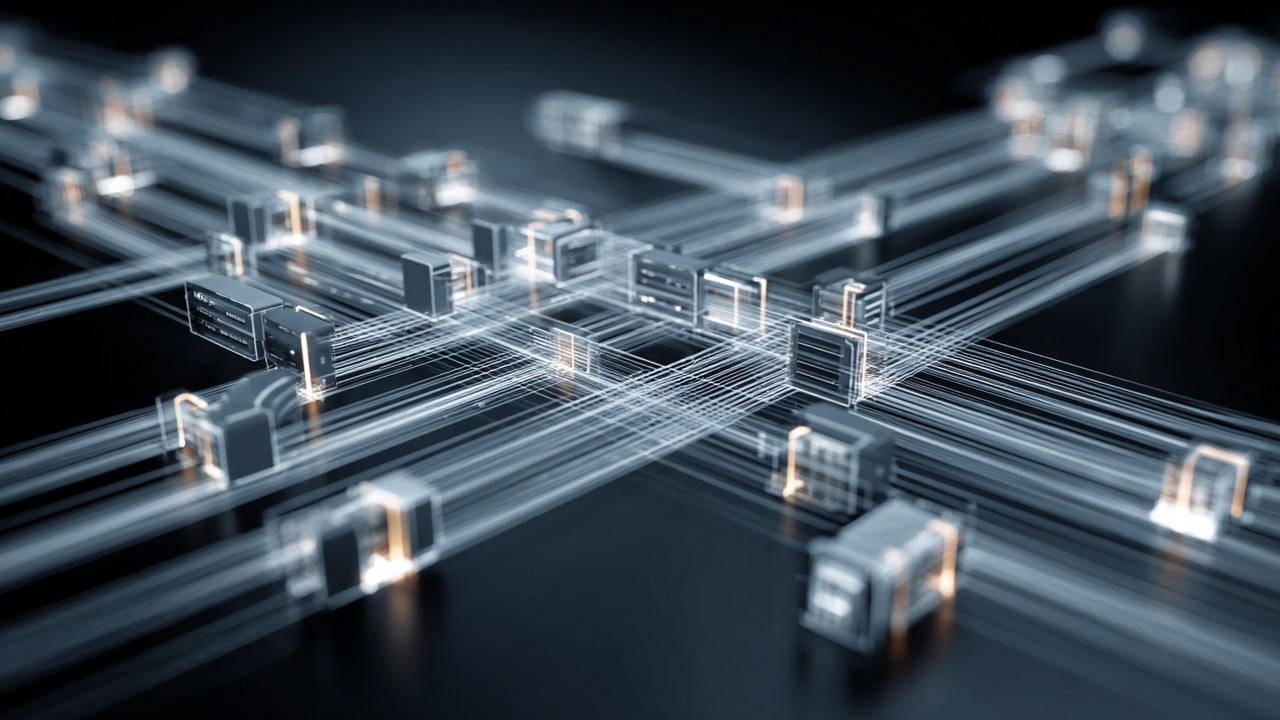

La multiplexación de conexiones se refiere a la técnica de enviar múltiples flujos independientes de datos simultáneamente a través de una única conexión de red. En el contexto de HTTP/2, este enfoque cambia fundamentalmente la forma en que los clientes y servidores web se comunican en comparación con el protocolo HTTP/1.1 más antiguo. Mientras que HTTP/1.1 típicamente abre múltiples conexiones TCP para manejar solicitudes paralelas, HTTP/2 emplea una única conexión TCP sobre la cual se multiplexan múltiples flujos.

Este cambio es significativo porque HTTP/2 introduce el concepto de flujos—canales lógicos e independientes dentro de la misma conexión física. Cada flujo transporta una secuencia discreta de tramas que representan solicitudes y respuestas HTTP. Esta gestión de flujos en HTTP/2 permite que navegadores y servidores envíen y reciban múltiples solicitudes simultáneamente sin la sobrecarga de establecer nuevas conexiones para cada una.

Los beneficios de la multiplexación en HTTP/2 son profundos. Al consolidar múltiples intercambios de datos en una sola conexión, las conexiones multiplexadas reducen la latencia causada por la configuración y cierre de conexiones TCP. Esta reducción en la sobrecarga se traduce directamente en tiempos de carga de página más rápidos y una mejor capacidad de respuesta. Además, la multiplexación evita las limitaciones del manejo serializado de solicitudes de HTTP/1.1, permitiendo un uso más eficiente del ancho de banda disponible.

Un aspecto importante de la multiplexación de conexiones es su papel en mitigar la congestión de red y el impacto de la pérdida de paquetes. Dado que todos los flujos comparten la misma conexión TCP, el protocolo emplea mecanismos avanzados de control de flujo y priorización para asegurar que los recursos críticos se carguen rápidamente incluso cuando las condiciones de la red fluctúan.

En términos prácticos, esto significa que los sitios web modernos que aprovechan las conexiones multiplexadas de HTTP/2 pueden entregar contenido más rico de manera más rápida, mejorando la experiencia y satisfacción del usuario. La capacidad de gestionar múltiples flujos sobre una sola conexión también simplifica la gestión de recursos del servidor y reduce la probabilidad de cuellos de botella relacionados con la conexión.

En general, la multiplexación de conexiones representa un avance fundamental en el diseño de protocolos web. Su integración en HTTP/2 no solo redefine el manejo de flujos, sino que también establece una nueva base para cómo se aborda la optimización del rendimiento en el desarrollo web. Al permitir múltiples flujos simultáneos dentro de una única conexión TCP, la multiplexación en HTTP/2 juega un papel crucial en la reducción de la latencia, el aumento de la velocidad de carga y el impulso de la evolución hacia experiencias web más rápidas y eficientes.

Cómo la gestión de flujos en HTTP/2 influye en el Tiempo hasta el Primer Byte (TTFB)

El Tiempo hasta el Primer Byte (TTFB) es una métrica crítica en el rendimiento web que mide la duración entre la solicitud de un cliente y la llegada del primer byte de la respuesta del servidor. Esta métrica no solo es esencial para entender la velocidad de carga de la página, sino que también juega un papel vital en el posicionamiento SEO y la experiencia del usuario. Valores más bajos de TTFB suelen indicar un servidor y una configuración de red más receptivos, lo que los motores de búsqueda recompensan con mejor visibilidad.

La relación entre la gestión de flujos en HTTP/2 y la optimización del TTFB es intrínseca. Al aprovechar la multiplexación, HTTP/2 puede manejar múltiples solicitudes simultáneamente a través de una única conexión, minimizando los retrasos que tradicionalmente inflan el TTFB en HTTP/1.1. En el protocolo anterior, los navegadores a menudo tenían que esperar a que una solicitud se completara antes de iniciar otra debido al bloqueo de cabeza de línea (HOL), lo que afectaba gravemente el TTFB.

HTTP/2 resuelve este problema permitiendo que múltiples flujos coexistan y se procesen de forma independiente. Este modelo de conexión multiplexada reduce significativamente el tiempo de espera para el primer byte de recursos posteriores. Por ejemplo, si una página web solicita CSS, JavaScript e imágenes simultáneamente, HTTP/2 puede enviar estas solicitudes en flujos paralelos sin esperar a que uno termine antes de comenzar el siguiente.

Mecanismos como la priorización de flujos y el control de flujo mejoran aún más la eficiencia de este proceso. La gestión de flujos en HTTP/2 asigna niveles de prioridad a diferentes flujos, asegurando que recursos críticos como HTML y CSS se entreguen antes que activos menos críticos como imágenes o fuentes. Esta priorización impacta directamente en el TTFB al acelerar la entrega de recursos que afectan el renderizado inicial de la página web.

Una diferencia técnica clave que influye en el TTFB es cómo HTTP/2 elimina el problema del bloqueo de cabeza de línea (HOL) prevalente en HTTP/1.1. En HTTP/1.1, si un paquete en una conexión se retrasa o se pierde, todos los paquetes posteriores deben esperar, lo que aumenta el TTFB. Por el contrario, los flujos multiplexados de HTTP/2 pueden continuar de forma independiente, por lo que los retrasos en un flujo no detienen a los demás.

Analizando ejemplos del mundo real, los sitios web que han migrado a HTTP/2 suelen reportar mejoras significativas en el TTFB. Estudios de caso revelan reducciones en el TTFB de hasta un 30-40%, lo que se traduce en tiempos de carga de página notablemente más rápidos y mejores métricas de compromiso del usuario. Estas mejoras subrayan la ventaja práctica de usar la multiplexación de HTTP/2 para reducir el TTFB.

En resumen, la avanzada gestión de flujos de HTTP/2 optimiza el TTFB al manejar múltiples solicitudes simultáneamente, priorizar datos críticos y superar las limitaciones de HTTP/1.1. Esta optimización no solo mejora el rendimiento de HTTP/2, sino que también contribuye a mejores resultados SEO al ofrecer sitios web más rápidos y receptivos que satisfacen tanto a usuarios como a motores de búsqueda.

Análisis técnico profundo sobre la priorización de flujos y el control de flujo en HTTP/2

Un aspecto fundamental de la eficiente priorización de flujos en HTTP/2 radica en su capacidad para controlar el orden en que se cargan los recursos. A cada flujo en HTTP/2 se le puede asignar un peso y una dependencia, lo que permite que el cliente y el servidor comuniquen la importancia de los recursos. Este sistema ayuda a garantizar que componentes vitales, como el documento HTML principal o el CSS crítico, se transmitan antes que activos menos urgentes.

El control de flujo en HTTP/2 complementa la priorización al gestionar cuánto dato puede enviarse en cada flujo en un momento dado. Este mecanismo evita que un solo flujo monopolice el ancho de banda de la conexión, asegurando una distribución equitativa de los recursos de red entre múltiples flujos. El control de flujo se implementa mediante actualizaciones de ventana que regulan la cantidad de datos que un emisor puede transmitir antes de recibir el acuse de recibo del receptor.

Juntos, la priorización y el control de flujo crean un equilibrio que maximiza el rendimiento mientras minimiza la latencia. Por ejemplo, si un flujo de alta prioridad solicita la página HTML principal, el servidor puede asignar más ancho de banda a este flujo, acelerando su entrega y mejorando la experiencia general del usuario.

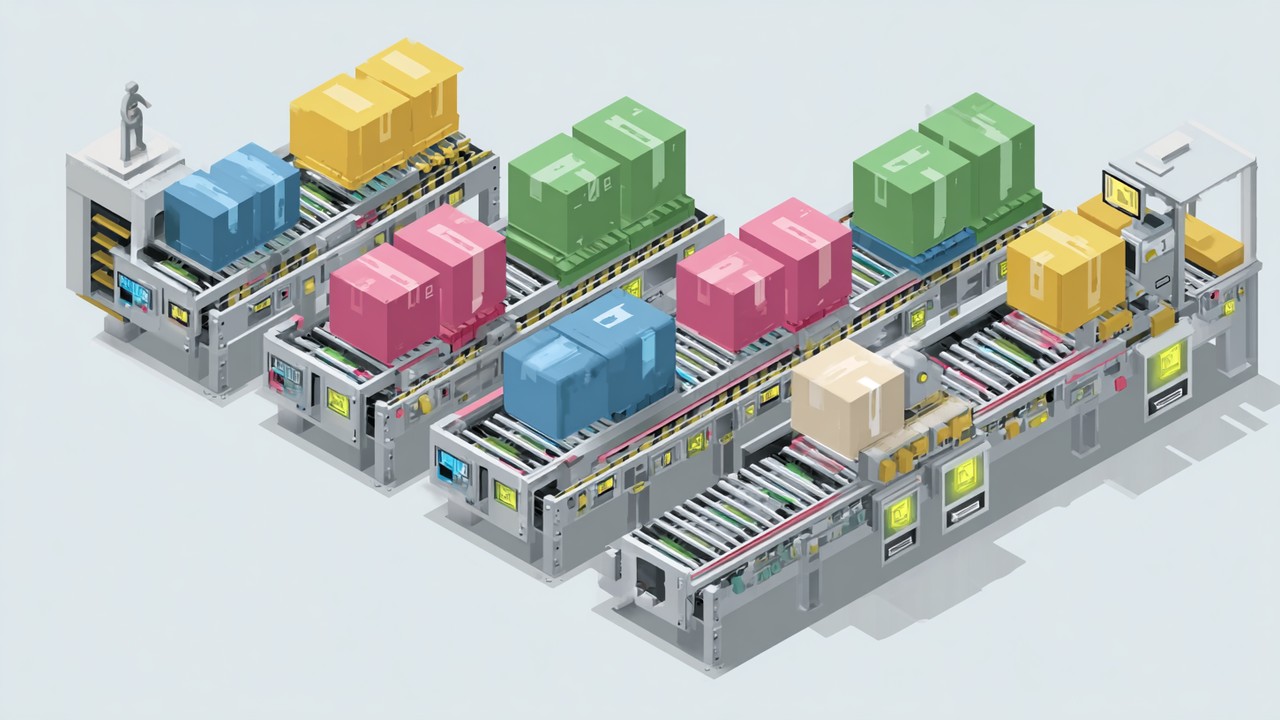

Para ilustrar, consideremos un escenario simplificado: un navegador solicita tres recursos—HTML (alta prioridad), CSS (prioridad media) e imágenes (baja prioridad). La priorización de HTTP/2 asegura que el flujo HTML se sirva primero, seguido por CSS, mientras que las imágenes se cargan al final. El control de flujo regula estos flujos para que ninguno detenga a los demás, manteniendo un flujo de datos fluido.

Estos mecanismos son críticos para mantener la eficiencia de los flujos multiplexados. Sin una priorización adecuada, la multiplexación por sí sola podría provocar competencia por recursos, donde flujos menos importantes consumen ancho de banda en detrimento de los críticos, afectando negativamente el TTFB y la velocidad de carga de la página.

Visualizando este proceso, se puede imaginar una cinta transportadora donde los paquetes priorizados se colocan al frente, mientras que el control de flujo actúa como un guardián que regula cuántos paquetes pasan a la vez. Esta orquestación mantiene la entrega constante y ordenada de recursos, optimizando el rendimiento web.

En conclusión, la combinación de priorización de flujos y control de flujo en HTTP/2 es esencial para gestionar eficazmente las conexiones multiplexadas. Esta sinergia garantiza que los recursos críticos se entreguen puntualmente, mejorando el TTFB y la capacidad de respuesta general del sitio. Comprender y aprovechar estas características técnicas es vital para los desarrolladores que buscan optimizar sus implementaciones de HTTP/2.

Mejores prácticas para aprovechar la multiplexación de HTTP/2 y mejorar el rendimiento web

Para aprovechar al máximo el poder de la multiplexación de HTTP/2 y mejorar la velocidad y capacidad de respuesta de un sitio web, los desarrolladores y propietarios deben adoptar estrategias específicas que optimicen la gestión de flujos. La optimización del rendimiento de HTTP/2 efectiva implica configuraciones tanto del lado del servidor como del cliente, una priorización cuidadosa de recursos y un monitoreo continuo para reducir la latencia y mejorar el TTFB.

Optimizar configuraciones del servidor y del cliente

En el lado del servidor, habilitar el soporte de HTTP/2 es el paso fundamental. La mayoría de los servidores web modernos como Apache, Nginx e IIS soportan HTTP/2, pero una configuración adecuada es clave para desbloquear los beneficios de las conexiones multiplexadas. Por ejemplo:

- Habilitar HTTP/2 con TLS: Dado que HTTP/2 se despliega predominantemente sobre HTTPS, asegurar configuraciones robustas de TLS con suites de cifrado modernas mejora la seguridad sin sacrificar la velocidad.

- Configurar límites de concurrencia de flujos: Ajustar la configuración del servidor para permitir un número óptimo de flujos simultáneos por conexión, equilibrando la disponibilidad de recursos y la carga.

- Implementar políticas eficientes de priorización: Los servidores pueden configurarse para respetar las prioridades de flujo del cliente, garantizando que los activos críticos se entreguen puntualmente.

Del lado del cliente, minimizar solicitudes innecesarias y agrupar recursos de manera inteligente complementa la multiplexación. Aunque HTTP/2 reduce la necesidad de concatenar recursos, un exceso de flujos paralelos puede saturar los mecanismos de control de flujo y causar degradación del rendimiento. Encontrar un equilibrio es crucial.

Medir el TTFB y la efectividad de la multiplexación

El seguimiento de mejoras requiere herramientas de medición confiables enfocadas tanto en el TTFB como en métricas de multiplexación HTTP/2. Herramientas populares de rendimiento web como:

- WebPageTest: Ofrece gráficos detallados en cascada que ilustran cómo interactúan los flujos multiplexados y su impacto en el TTFB.

- Chrome DevTools: Proporciona información en tiempo real sobre solicitudes de red, priorización de flujos y desglose de tiempos.

- Lighthouse: Evalúa el rendimiento general de la página, destacando áreas donde se pueden maximizar los beneficios de la multiplexación HTTP/2.

Analizar regularmente estas métricas ayuda a identificar cuellos de botella causados por una gestión ineficiente de flujos o configuraciones incorrectas del servidor.

Evitar errores comunes en la multiplexación

Aunque la multiplexación de HTTP/2 ofrece muchas ventajas, una implementación incorrecta puede provocar consecuencias no deseadas:

- Priorización ineficiente de flujos: Sin una priorización correcta, los recursos críticos pueden retrasarse, anulando las ganancias en TTFB.

- Exceso de flujos paralelos: Abrir demasiados flujos simultáneamente puede saturar las ventanas de control de flujo, causando congestión y aumento de latencia.

- Ignorar clientes heredados HTTP/1.1: Algunos usuarios aún pueden conectarse mediante HTTP/1.1, por lo que son necesarios mecanismos de retroceso y optimizaciones para ambos protocolos.

Ser consciente de estos errores garantiza transiciones más fluidas a HTTP/2 y mejoras sostenidas en el rendimiento.

Integrar la multiplexación con otras técnicas de optimización

La multiplexación HTTP/2 funciona mejor cuando se combina con estrategias complementarias de rendimiento:

- Caché: Aprovechar el almacenamiento en caché del navegador y del servidor reduce solicitudes redundantes, aliviando la carga de flujos.

- Redes de entrega de contenido (CDNs): Distribuir contenido geográficamente acorta los tiempos de ida y vuelta, amplificando los beneficios de la multiplexación.

- Compresión y minificación de recursos: Paquetes más pequeños aceleran la transmisión, haciendo los flujos multiplexados más eficientes.

- Carga diferida (lazy loading): Posponer recursos no críticos optimiza la priorización de flujos y reduce el TTFB inicial.

En conjunto, estas tácticas forman un enfoque integral para el rendimiento web, amplificando las ventajas de las conexiones multiplexadas de HTTP/2.

Recomendaciones finales

Para optimizar eficazmente la multiplexación de HTTP/2, los propietarios de sitios deben:

- Asegurarse de que HTTP/2 esté habilitado y configurado correctamente en el servidor.

- Monitorear el TTFB y la actividad de los flujos con herramientas especializadas.

- Priorizar con precisión los recursos críticos para evitar retrasos.

- Gestionar el número de flujos concurrentes para prevenir congestión.

- Combinar la multiplexación con caché, CDNs y compresión para un impacto máximo.

Siguiendo estas mejores prácticas, los sitios web pueden lograr reducciones sustanciales en el TTFB, entregando contenido más rápido y mejorando la experiencia del usuario, lo que influye positivamente en el SEO y la interacción.

Evaluación del impacto de la multiplexación de conexiones en la velocidad real de los sitios web y el SEO

La adopción de HTTP/2 y sus capacidades de conexiones multiplexadas tiene efectos demostrables en la velocidad de los sitios web y el rendimiento SEO. Los estudios muestran consistentemente que los sitios que utilizan HTTP/2 experimentan un TTFB más rápido, lo que se correlaciona fuertemente con mejores posiciones en los motores de búsqueda y mayor satisfacción del usuario.

Influencia de la multiplexación de conexiones en el posicionamiento SEO

Los motores de búsqueda priorizan señales de experiencia del usuario como la velocidad de carga y la capacidad de respuesta. Dado que la multiplexación de conexiones reduce la latencia al permitir flujos de datos simultáneos, contribuye directamente a una entrega de contenido más rápida. Esta mejora en el TTFB es especialmente importante para usuarios móviles o aquellos en redes de alta latencia, donde los retrasos pueden afectar significativamente las tasas de rebote y el compromiso.

Los datos del mundo real indican que los sitios que aprovechan la multiplexación de HTTP/2 suelen posicionarse mejor debido a métricas de carga superiores. Un TTFB más rápido significa que los rastreadores de los motores de búsqueda reciben el contenido más rápido, permitiendo una indexación más eficiente y mejores señales para el ranking.

Mejor experiencia de usuario y mayor compromiso

Más allá del SEO, los beneficios de velocidad de la multiplexación HTTP/2 se traducen en mejoras tangibles en la experiencia del usuario. La reducción de los tiempos de espera fomenta visitas más largas, mayores tasas de conversión y menor abandono. Los estudios muestran que incluso milisegundos reducidos en el TTFB pueden aumentar la retención de usuarios, haciendo de la multiplexación una herramienta valiosa para el crecimiento empresarial.

Escenarios comparativos: con y sin multiplexación HTTP/2

Al comparar sitios web con multiplexación HTTP/2 habilitada frente a aquellos que dependen de HTTP/1.1 o HTTP/2 no optimizado, las diferencias en velocidad y SEO son evidentes:

- Sin multiplexación: Múltiples conexiones TCP generan sobrecarga, incrementando el TTFB y ralentizando la entrega de recursos.

- Con multiplexación: Una sola conexión maneja múltiples flujos eficientemente, reduciendo la latencia y acelerando el renderizado de la página.

Este contraste resalta la ventaja estratégica de adoptar HTTP/2 para la infraestructura web moderna.

Recomendaciones estratégicas para empresas

Para las empresas que buscan mejorar el SEO y la velocidad del sitio web, la transición a HTTP/2 con soporte adecuado para multiplexación es un paso crítico. Requiere inversión en actualizaciones de servidores, ajuste de configuraciones y monitoreo continuo del rendimiento, pero ofrece retornos significativos en posicionamiento y compromiso de usuarios.

Además, integrar la multiplexación con otras estrategias de optimización —como caché, CDNs y compresión— maximiza las ganancias de rendimiento.

Conclusiones clave sobre el valor estratégico de la multiplexación de conexiones

- La multiplexación de conexiones es un elemento fundamental de HTTP/2 que acelera la transmisión de datos al manejar múltiples flujos concurrentemente.

- Esta tecnología reduce significativamente el TTFB, una métrica vital tanto para SEO como para la experiencia del usuario.

- La gestión adecuada de flujos, la priorización y el control de flujo son esenciales para aprovechar completamente los beneficios de la multiplexación.

- La evidencia empírica respalda las ventajas en SEO y rendimiento de adoptar la multiplexación HTTP/2.

- Las empresas que mejoran su infraestructura web con multiplexación HTTP/2 se posicionan para obtener mejores rankings, tiempos de carga más rápidos y mayor compromiso de usuarios.

Adoptar la multiplexación de conexiones como parte de una estrategia integral de rendimiento web es indispensable para las organizaciones que buscan ventaja competitiva en el panorama digital actual.